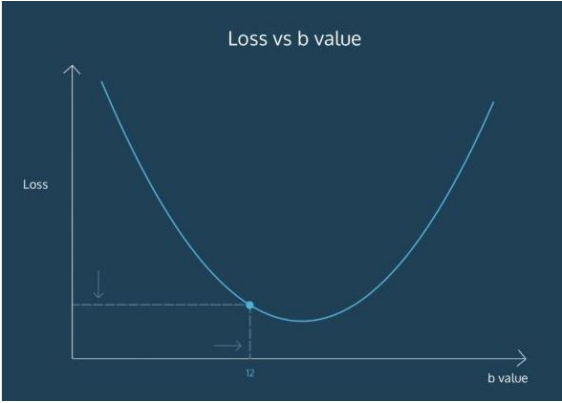

<Linear Regression> 통계학에서 선형 회귀(linear regression)는 종속 변수 y와 한 개 이상의 독립 변수(또는 설명 변수 ) x와의 선형 상관관계를 모델링 하는 회귀분석 기법이다. 한 개의 설명 변수에 기반한 경우 단순 선형 회귀(simple linear regression), 둘 이상의 설명 변수에 기반한 경우에는 다중 선형 회귀(Multiple Linear Regression)라고 한다. 선형 회귀는 선형 예측 함수를 사용해 회귀식을 modeling 하며, 알려지지 않은 parameter는 data로부터 추정한다. 이렇게 만들어진 회귀식을 모델이라고 한다. 위 두 개의 식 중 위의 식이 단순 선형 회귀 분석의 수식, 아래의 식이 다중 선형 회귀 분석의 수식 형태입니다. 위 식의 형태에서 각각의 변수들이 의미하는 바를 생각해 보면, y는 주어진 입력에 대한 출력(label) 값, x는 입력 데이터에 해당합니다. 즉, 이미 알고 있는 data(x, y) ...

#gradientdescent

#linearregression

#MSE

#개념공부

#머신러닝

#머신러닝기초

#선형회귀

#정리

원문링크 : Linear Regression(선형회귀)에 대한 정리

![[알고리즘] BFS(Breadth-First Search), 너비 우선 탐색 방식](https://mblogthumb-phinf.pstatic.net/MjAyMjA1MzFfOTUg/MDAxNjUzOTg2Nzc0MTU1.uiZNqkjB8IK9t83JThFqplq5GxeFkYjQw2VaTNTkzUgg.zq_PNdOb8VoDNEkUG0FyE91iZ4drN4VXQCC61BPZ1LUg.GIF.book541/graph_result.gif?type=w2)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티