![<Attention> [TransNormer] Scaling TransNormer to 175 Billion Parameters <Attention> [TransNormer] Scaling TransNormer to 175 Billion Parameters](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FEIp1j%2FbtsqLRxcod5%2FLaDLhe5NNqul6P9eqD13L1%2Fimg.png)

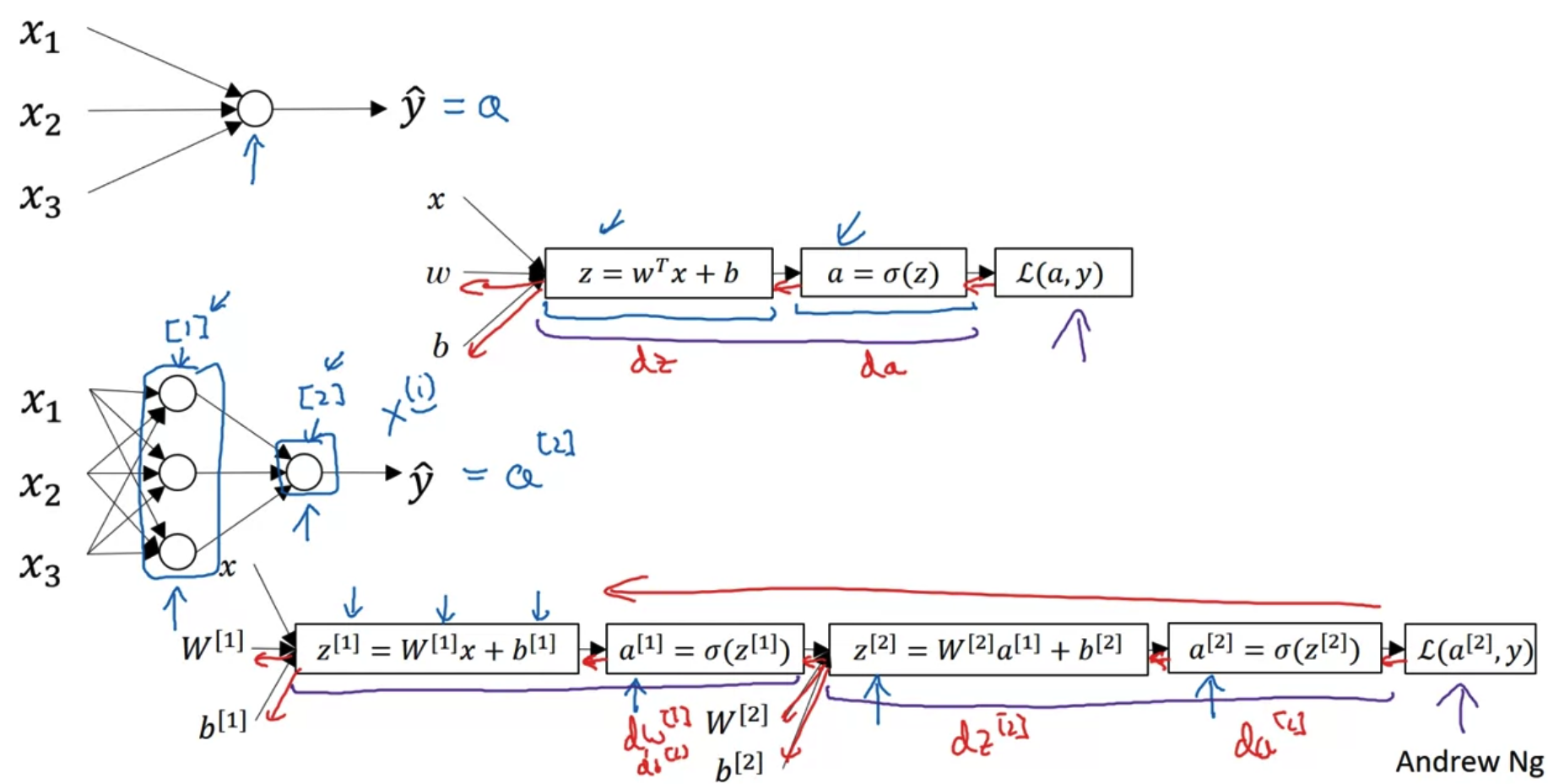

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success 전통적인 somftmax 기반의 attention 모델이 아닌 Linear Attention 기반의 LLM, TransNormerLLM. positional embedding, linear attention acceleration, gating mechanism, tensor normalization, inference acceleration 등의 방식을 적용. linear attention을 가속화하는 Lightning Attention을 제시. 배경 대부분의 인공지능 모델들은 Transformer의 아키텍쳐를 기반으로 삼고 엄청난..

원문링크 : <Attention> [TransNormer] Scaling TransNormer to 175 Billion Parameters

![<CoT, Prompting> [Google DeepMind] Chain-of-Thought Reasoning Without Prompting (2024.02) <CoT, Prompting> [Google DeepMind] Chain-of-Thought Reasoning Without Prompting (2024.02)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbGwyWe%2FbtsE7uGJ7xW%2F5EE4ksZL0UEVFUxBxGg301%2Fimg.png)

![<LLM> [Qwen] Qwen Technical Report <LLM> [Qwen] Qwen Technical Report](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbA6rTE%2Fbtsv5ocNUbg%2FvrGCfyG6jpkPKwliiZ90Mk%2Fimg.png)

![[BOJ] 14500 : 테트로미노 [브루트포스](Python) [BOJ] 14500 : 테트로미노 [브루트포스](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티