![<LK Lab, Retrieval> [RoSPr] Efficiently Enhancing Zero-Shot Performance of Instruction Following Model via Retrieval of Soft Prompt (2023.10) <LK Lab, Retrieval> [RoSPr] Efficiently Enhancing Zero-Shot Performance of Instruction Following Model via Retrieval of Soft Prompt (2023.10)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FblPRAi%2FbtsAkjwetjo%2FAzdZK6sbyQNDJEqJaQzyBk%2Fimg.png)

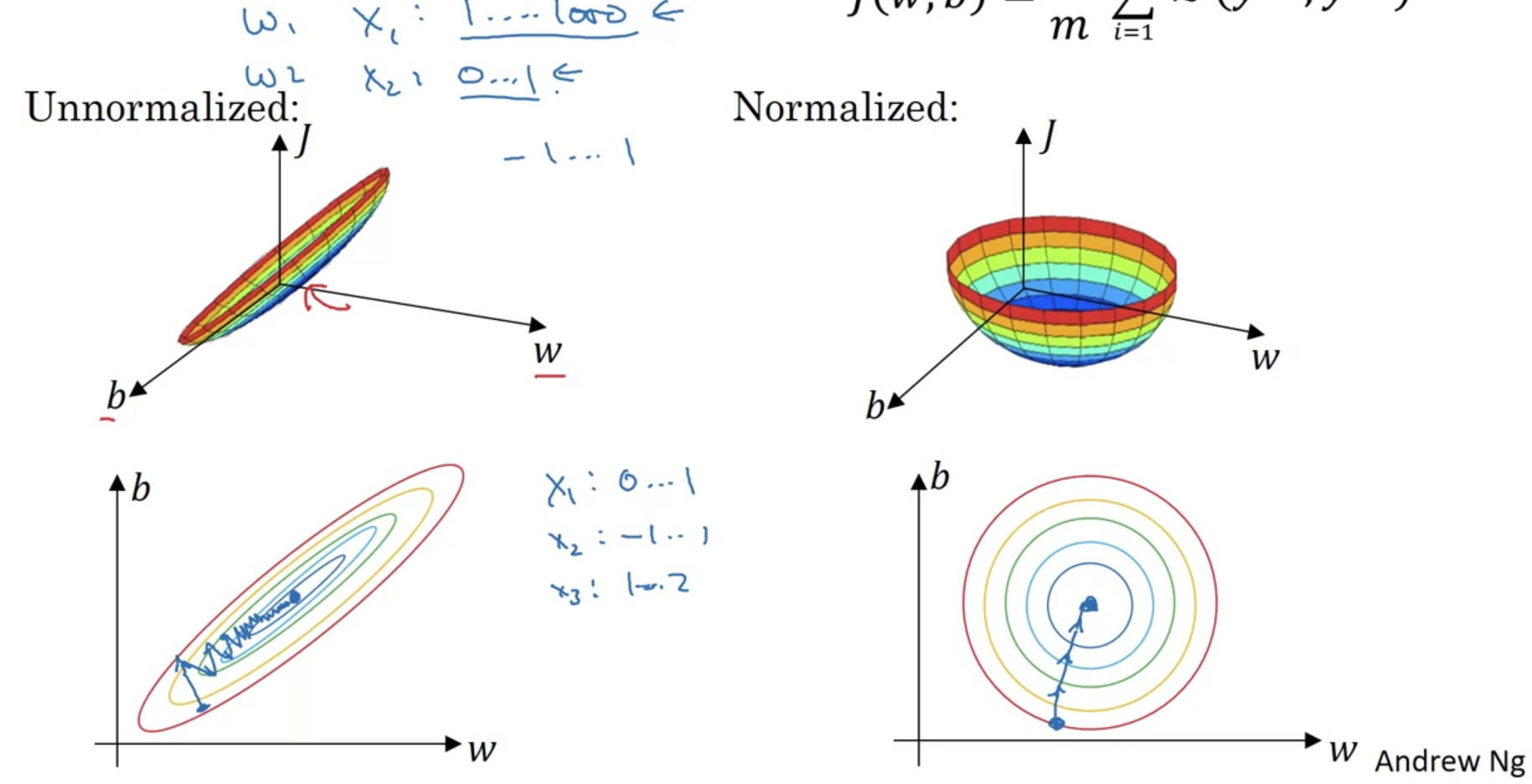

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다. (Language & Knowledge Lab의 Retreival 관련) 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ [KAIST] - prompt tuning을 통해 얻은 soft prompt의 retrieval이 hard prompt를 사용하는 zero-shot task의 일반화에 도움이 된다는 것을 확인 - T0 모델의 성능을 향상시키기 위해 추가된 파라미터의 수는 전체의 0.007%에 불과함 - Retrieval of Soft Prompt (RoSPr) 배경 instruction tuning에서 모델 성능 향상시키는 방법은 크게 1) scaling the number of training datasets 2) scaling ..

![<LK Lab, Alignment> [ALMoST] Aligning Large Language Models through Synthetic Feedback (2023.10) <LK Lab, Alignment> [ALMoST] Aligning Large Language Models through Synthetic Feedback (2023.10)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FcBH6Qz%2FbtsAakxpR5B%2F0iF7ksgPf8zKM6PQjKFxE0%2Fimg.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티