![<NLP> [Transformer] Attention Is All You Need (2017.06) <NLP> [Transformer] Attention Is All You Need (2017.06)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FLUlR6%2FbtsDdGcNxX1%2FIiSu3QrpQ7Ncl8vLgqBmV1%2Fimg.png)

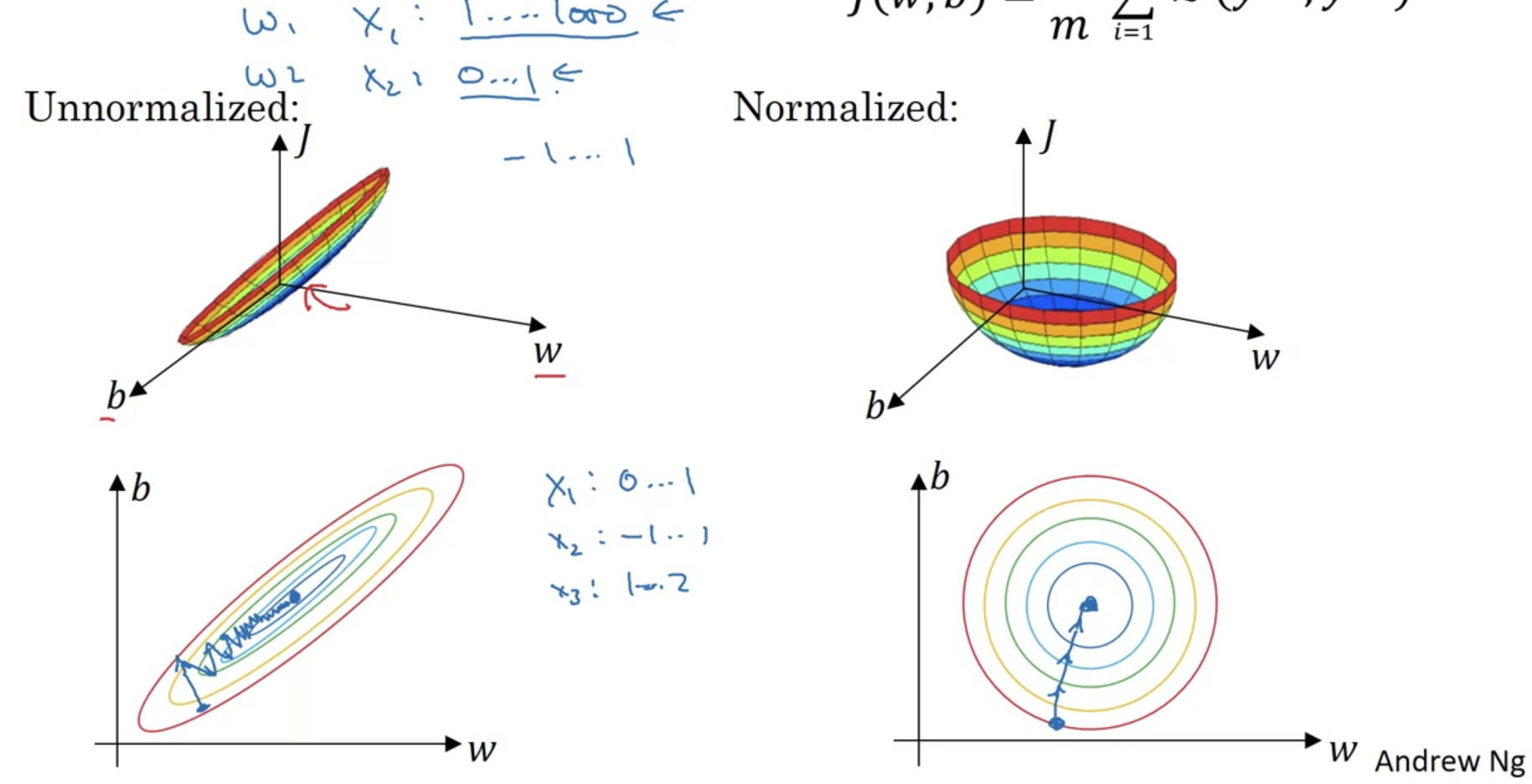

NLP 분야의 (지금은 분야를 막론하고 그렇지만) 전설적인 논문인 Attention Is All You Need를 읽고 간단히 정리해보았습니다. 100% 이해하는 것이 쉽지 않기도 하고.. 자세히 정리하다가는 하루가 꼬박 날아갈 가능성이 있어 핵심적인 개념들 위주로 정리하며 복습해볼 생각입니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Google Brain, Google Research, University of Toronto] - 오직 attention mechanism만으로 구성된 simple network architecture, Transformer를 제안 - 영어를 다른 언어로 번역하는 태스크에서 뛰어난 일반화 성능을 보임 1..

원문링크 : <NLP> [Transformer] Attention Is All You Need (2017.06)

![[프로그래머스] 햄버거 만들기(Python) [프로그래머스] 햄버거 만들기(Python)](http://blog.kakaocdn.net/dn/eeUxOi/btrZjgpXXvf/beyGuTwKg2EPY0DPGZImV0/img.png)

![[Kaggle] OSError, Connection error? 인터넷을 연결하는 방법..(+ GPU 설정) [Kaggle] OSError, Connection error? 인터넷을 연결하는 방법..(+ GPU 설정)](http://blog.kakaocdn.net/dn/v3KLe/btr0KQWCjCc/H0oZGD9saPlCPgA2i8nOlk/img.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티