![<Attention> [CALM] LLM Augmented LLMs: Expanding Capabilities through Composition (2024.01) <Attention> [CALM] LLM Augmented LLMs: Expanding Capabilities through Composition (2024.01)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2F9ti4B%2FbtsDAScYB79%2FHOyOvFuF1ns2KUXMFm1X91%2Fimg.png)

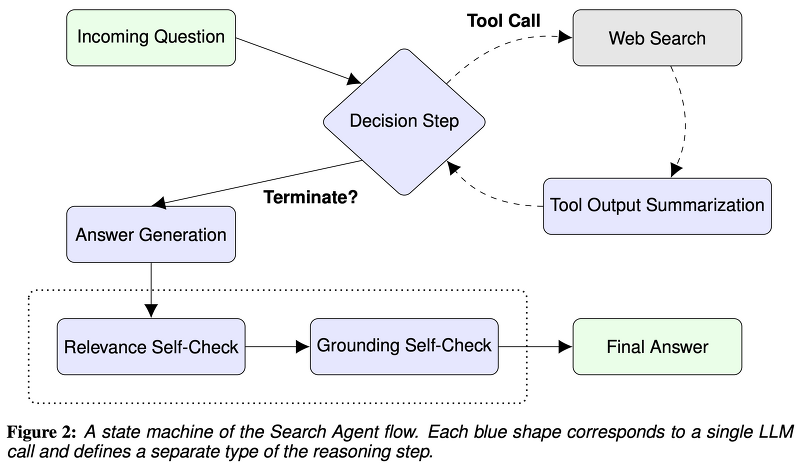

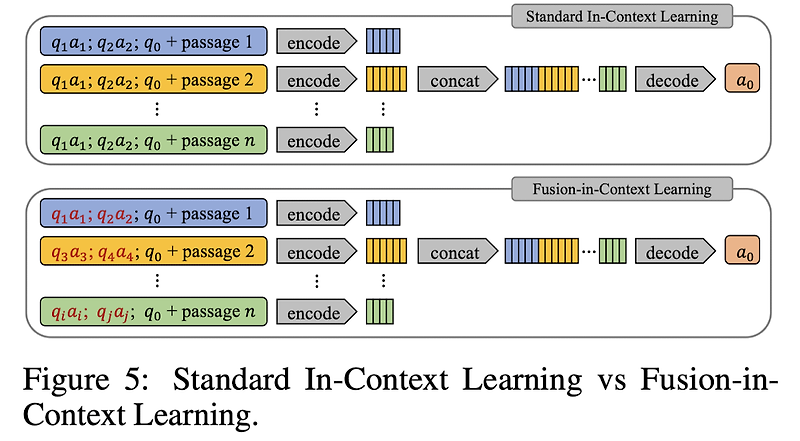

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Google Research, Google DeepMind] - 다른 모델 간의 cross-attention을 통해 새로운 capabilities를 획득하게 하는 기법, CALM - Composition to Augment Language Models - 기존 LLM은 're-using'하면서 새로운 few additional parameters와 data를 사용 - 다양한 도메인과 환경에 적용 가능하다는 특징(장점)을 보유 1. Introduction LLM은 여러 태스크 중에서도 이전과 달리 commonsense 또는 factual reas..

원문링크 : <Attention> [CALM] LLM Augmented LLMs: Expanding Capabilities through Composition (2024.01)

![[BOJ] 9019 : DSLR [DFS/BFS](Python) [BOJ] 9019 : DSLR [DFS/BFS](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티