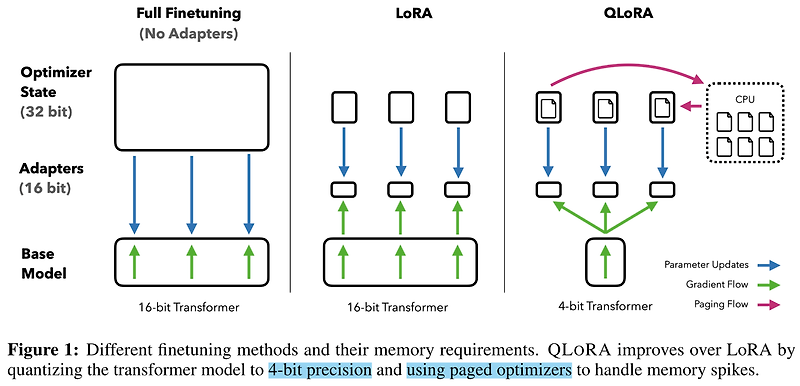

관심 있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ (코드 구현에 관한 내용은 마지막에 다루고 있습니다!!) usechatgpt init success [University of Washington] - 기학습된 모델을 4-bit로 quantize한 뒤 Low Rank Adapters(LoRA)를 학습하는 방식 - QLoRA로 학습된 model family, Guanaco를 공개. - ChatGPT의 99.3% 성능을 발휘할 수 있는 65B 모델을 single GPU에서 24시간 동안 fine-tuning - 세 개의 tenchiques: (a) 4-bit NormalFloat (NF4), (b) Double Quantization, (..

원문링크 : <PEFT> QLoRA (2023.05) 논문 상세 리뷰 및 간단 구현 (with Gemma)

![[BOJ] 1780 : 종이의 개수 [분할](Python) [BOJ] 1780 : 종이의 개수 [분할](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티