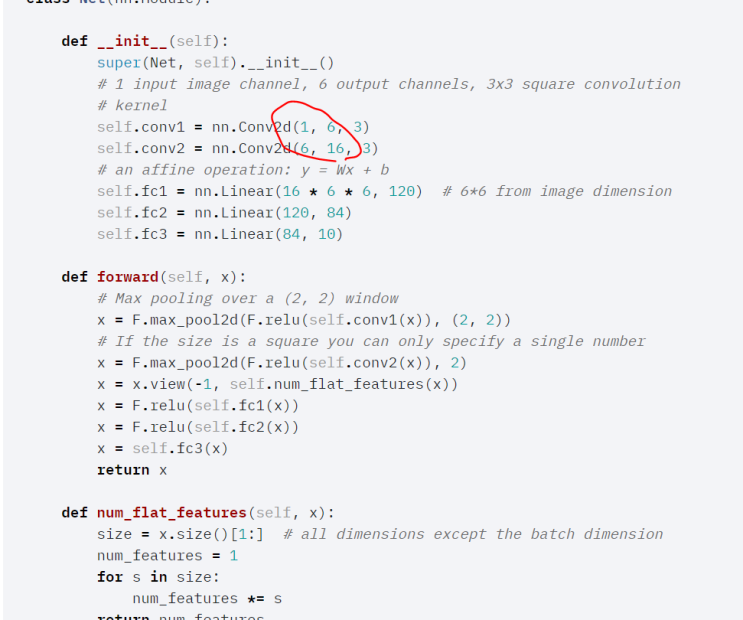

Q. 둘다 같은 net인데(Lenet) convolution할 때 왜 값을 다양하게 줄까?Q. 크면 클수록 메모리에 부담이 가는게 있을까?Q. 어떤게 학습이 더 잘된다는 것과 연관이 있을까?Q. 아니면 net version에 따른 차이인가, 처음과 끝만 잘 맞춰주면 되는가?1. 히든 유닛을 크게하면 메모리 올리는 양 많아짐2. 히든 유닛수가 크면 클수록 반드시 성능이 올라가진 않음3. 관습적으로 보통 3 64 128 256 늘려가며 사용4. vggnet 보면 확실히 감이 온다#convolutional_layer #input...

같은 net, 왜 다르게?에 대한 요약내용입니다.

자세한 내용은 아래에 원문링크를 확인해주시기 바랍니다.

원문링크 : 같은 net, 왜 다르게?

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티