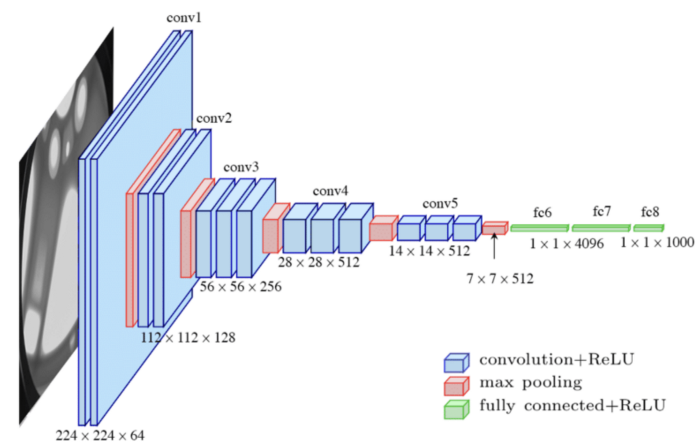

등장 배경 일반적으로 신경망이 깊어 질수록 풀링을 통해 레이어의 층 면적은(가로,세로) 줄어들더라도, 층의 깊이(피처맵의 수)는 늘어나게 됩니다. (VGG16그림 참조) 이때 5*5, 7*7같은 큰 필터까지 사용하게 되면 연산해야 하는 파라미터의 수를 급격히 증가하게 되고, 이는 곧 "비싼연산 비용 " 라는 문제를 발생시켰습니다. *CNN에서 파라미터 수 계산식: (filter.width*filter.height*이전 레이어층 수 +1)*필터의 수 (각 w*h*c 수식의 3번째값을 따라보다보면 64->128->256->512 이런식으로 깊이가 늘어나는 것을 볼 수 있습니다) 그래서 어떻게 하면 CNN의 층이 깊이 구현하면서 Computational cost를 획기적으로 줄일 수 있을까?라는 질문에서 ..

원문링크 : 1*1 합성곱층 (Convolution layer) 원리 및 목적 설명

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티