![[Python] sklearn 경사하강법(Gradient Descent)란? 사용방법 및 예제 실습(SGD) [Python] sklearn 경사하강법(Gradient Descent)란? 사용방법 및 예제 실습(SGD)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2Fd3wpHb%2FbtrVv2H2LDw%2F9Fqy2E7aiNPzD7UxJ7L1f0%2Fimg.png)

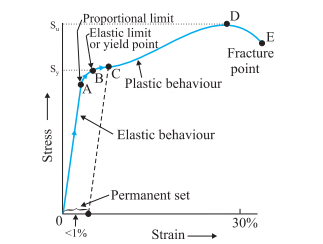

목차 파이썬 Gradient Descent란? 선형 회기(Linear Regression)는 데이터 셋(Data set)을 대표하는 하나의 선을 구하는 작업이었습니다. 즉, Y = a x X + b에서 기울기 값 a와 절편 값 b를 구하였습니다. 이때 사용된 방식은 RSS(Residual Sum of Squares)이었습니다. 잔차 제곱 방식라고 불리는 예측되는 선형회기 선과 실제 데이터 셋의 제곱 합이 최소가 되게 만드는 선형회기 선을 만드는 작업입니다. 그림에서 파란색선의 제곱의 합을 RSS(Residual Sum of Squares)라고 하고 RSS(Residual Sum of Squares)가 가장 작은 지점의 기울기와 절편을 구하는 알고리즘은 OLS(Ordinary Least Sqaures)라고..

원문링크 : [Python] sklearn 경사하강법(Gradient Descent)란? 사용방법 및 예제 실습(SGD)

![[Python]GPS파일(nmea)에서 위도, 경도, 속도, 시간 정보 읽어서 csv에 저장하기(Latitude, Longitude, Speed, Time) [Python]GPS파일(nmea)에서 위도, 경도, 속도, 시간 정보 읽어서 csv에 저장하기(Latitude, Longitude, Speed, Time)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FcweDP9%2FbtrQN7gVZNt%2FycNU8ym32vbyWKOiycprH1%2Fimg.png)

![[C/C++]연산자(Operator) 정리표 (비트, 논리, 산술 +=&^<<>>%~!) [C/C++]연산자(Operator) 정리표 (비트, 논리, 산술 +=&^<<>>%~!)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbG88J9%2FbtrnJA5wCiN%2FmFgfnMANkvAfOoOu6zWupK%2Fimg.png)

![[Python]엑셀의 동일한 값 몇 개 인지 카운트 Pandas에서 쉽게 처리하기(판다스, 숫자, 텍스트, 중복 삭제) [Python]엑셀의 동일한 값 몇 개 인지 카운트 Pandas에서 쉽게 처리하기(판다스, 숫자, 텍스트, 중복 삭제)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FXlcpg%2FbtrT4P49sfu%2FTLr9nKDve4aKr7W0PY2gak%2Fimg.jpg)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티