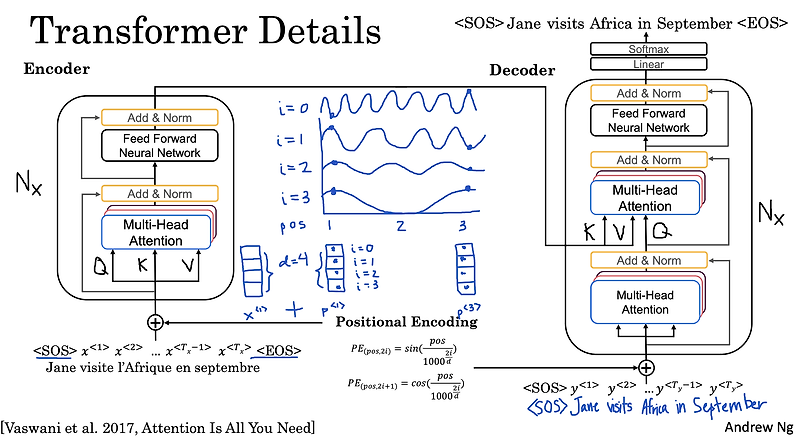

Transformer Details self-attention을 여러 번 중첩한 multi-head attention은 encoder / decoder 둘 다에서 쓰입니다. encoder부터 살펴보면, 주어진 입력 문장에 대해 multi-head attention을 수행하고 이를 feed forward합니다. 이 과정을 n번 반복합니다. (논문에서는 n=6으로 세팅했습니다) 즉, attention head를 8번 중첩해서 concat하고 forward하는 것을 6번 반복합니다. 이를 통해 입력 문장에 대해 각 단어(token) 간의 관계를 바탕으로 이해를 마칩니다. decoder는 문장의 시작을 알리는 토큰으로 시작합니다. 이를 시작으로 multi-head attention을 적용하여 구한 것을 다음 m..

원문링크 : Transforemrs(4) : Transformer Network

![<LLM> [Qwen] Qwen Technical Report <LLM> [Qwen] Qwen Technical Report](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbA6rTE%2Fbtsv5ocNUbg%2FvrGCfyG6jpkPKwliiZ90Mk%2Fimg.png)

![[프로그래머스] 연속된 부분 수열의 합 (Python) [프로그래머스] 연속된 부분 수열의 합 (Python)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FcTasgz%2FbtshA5wYmSR%2FoUUECq9s6vXawWAofC1qGK%2Fimg.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티