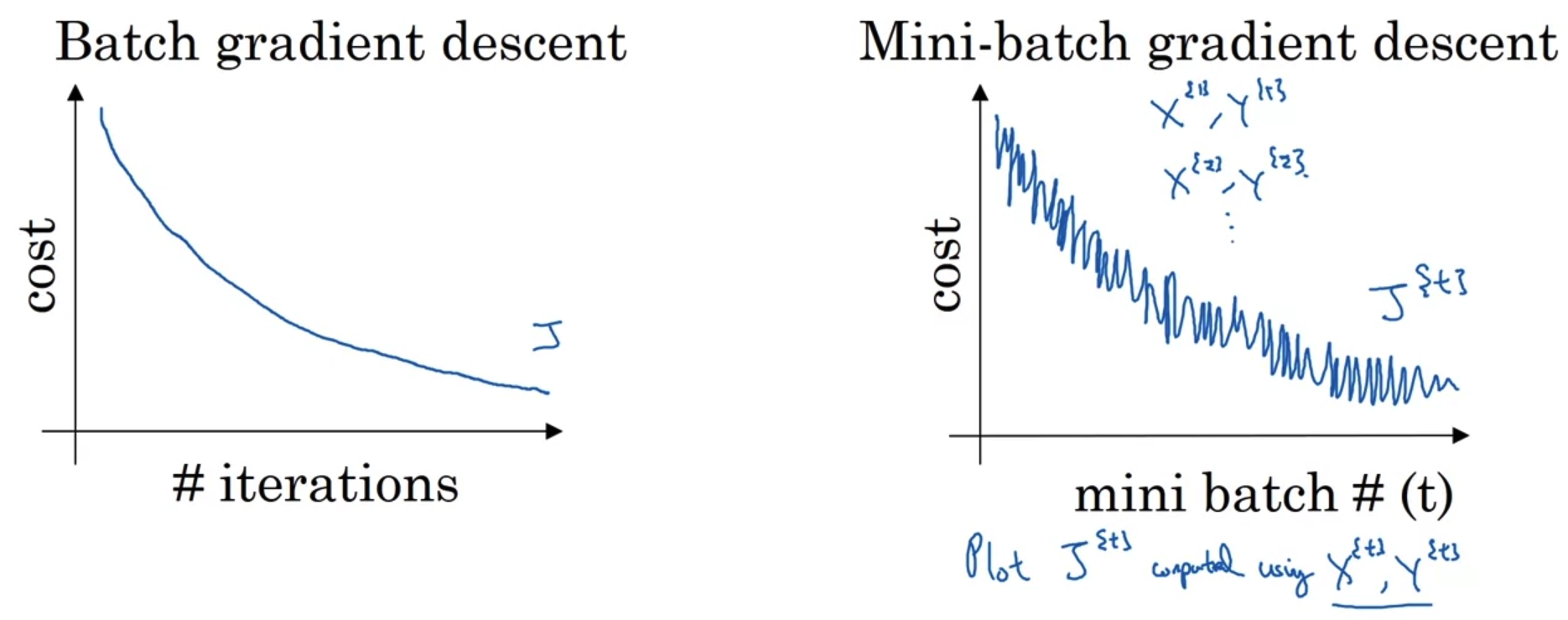

1. Mini-batch Gradient Descent Match vs. mini-batch gradient descent 많은 양의 데이터를 처리해야 하는 딥러닝은 연산 시간을 줄이는 여러 기법들이 필요하다. 그 중 하나가 여러 데이터를 일부씩 묶어 계산하는 방식인 mini-batch gradient descent이다. 만약 처리해야 하는 데이터의 개수가 5,000,000개라면 어떻게 될까? 이 많은 양의 데이터를 한꺼번에 forward하고 backward 하는 것은 엄청난 computing power를 필요로 할 것이고, 이것이 뒷받침된다고 하더라도 썩 좋은 시간적 효율을 보이진 못할 것이다. 따라서 우리는 이를 일정 개수(위 예에서는 1,000개)씩 묵어서 연산을 시도하기로 한다. 이때 묶인 각 b..

원문링크 : Optimization Algorithms(1) - Mini-batch

![<Attention> [CALM] LLM Augmented LLMs: Expanding Capabilities through Composition (2024.01) <Attention> [CALM] LLM Augmented LLMs: Expanding Capabilities through Composition (2024.01)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2F9ti4B%2FbtsDAScYB79%2FHOyOvFuF1ns2KUXMFm1X91%2Fimg.png)

![[BOJ] 5525 : IOIOI [문자열](Python) [BOJ] 5525 : IOIOI [문자열](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

![<LK Lab, Instruction> [RoE] Exploring the Benfits of Training Expert Language Models over Instruction Tuning (2023.02) <LK Lab, Instruction> [RoE] Exploring the Benfits of Training Expert Language Models over Instruction Tuning (2023.02)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2Fct4M8y%2FbtsAeDJxkLw%2FQPj787gqnRtYR5WgQAc5Y1%2Fimg.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티