![<Multi-modal> [BEiT] Image as a Foreign Language: BEiT Pretraining for All Vision and Vision-Language Tasks <Multi-modal> [BEiT] Image as a Foreign Language: BEiT Pretraining for All Vision and Vision-Language Tasks](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FEM2gM%2FbtsrBNmsaYw%2FC1pkVRPirkLZ1A4O1ZQFsk%2Fimg.png)

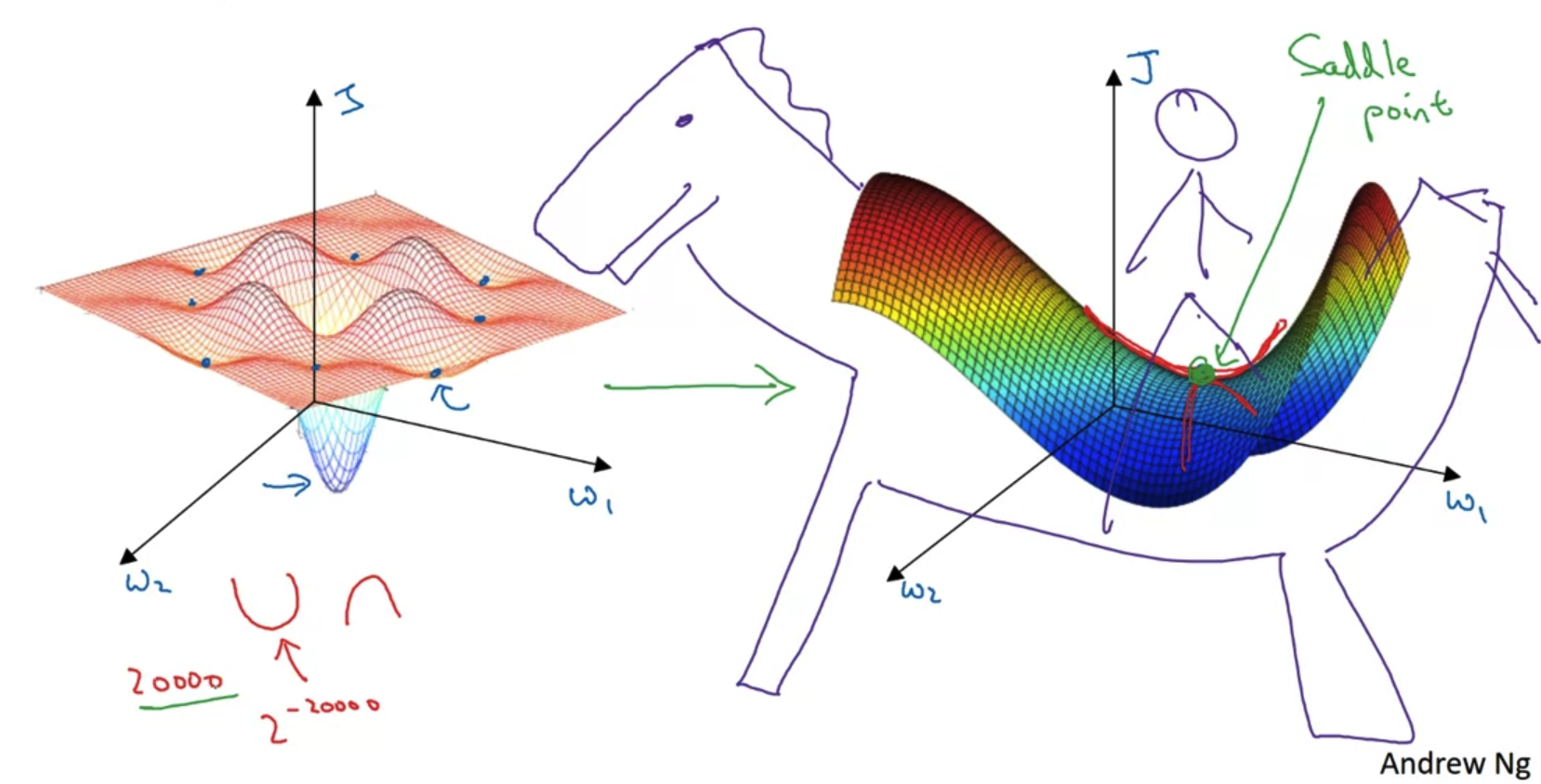

과거(2022.08)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Microsoft Corporation] vision 그리고 vision-language task를 고루 잘 수행하는 multimodal foundation model, BEiT-3 여러 pre-training 기법 중에서 오직 masked "language" modeling 기법만을 사용한 것이 특징 배경 Transformers의 아키텍쳐가 엄청나게 좋은 성능을 보이면서 다양한 분야로 퍼져 나갔고, 현재는 multi-modal 분야에도 이것이 활발하게 사용되고 있습니다.(Multiway Transformer) 물론 아직까지 이것이..

![<LK Lab, Retrieval> [Np Decoding] Nonparametric Decoding for Generative Retrieval (2023.05) <LK Lab, Retrieval> [Np Decoding] Nonparametric Decoding for Generative Retrieval (2023.05)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbMcvHV%2Fbtsz91K9PLV%2FDVBl5DWQhDXdX81n4lY8vK%2Fimg.png)

![[Short Paper Reveiw] AutoML-GPT: Automatic Machine Learning with GPT [Short Paper Reveiw] AutoML-GPT: Automatic Machine Learning with GPT](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FlTOBN%2FbtsgELT21pR%2FgY6SyNlE9r1atRKNMX1j70%2Fimg.png)

![<Benchmark> [MMHAL-BENCH] Aligning Large Multimodal Models with Factually Augmented RLHF <Benchmark> [MMHAL-BENCH] Aligning Large Multimodal Models with Factually Augmented RLHF](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2Fb0UEt1%2FbtswcJfMXD9%2FRuZBOEa4TDK0YGSMhCS0Y1%2Fimg.png)

![<Distillation, Decoding> [Proxy-tuning] Tuning Language Models by Proxy (2024.01) <Distillation, Decoding> [Proxy-tuning] Tuning Language Models by Proxy (2024.01)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FcfceqS%2FbtsD6vN6Sl5%2F5aDtHZaOZ1LEQa9vcT3kAk%2Fimg.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티