![<Image> [ViT] An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale <Image> [ViT] An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2Fbh4OI0%2FbtsvaCVCHoi%2FzaQ9OiLISKBkEHMYluw1V1%2Fimg.png)

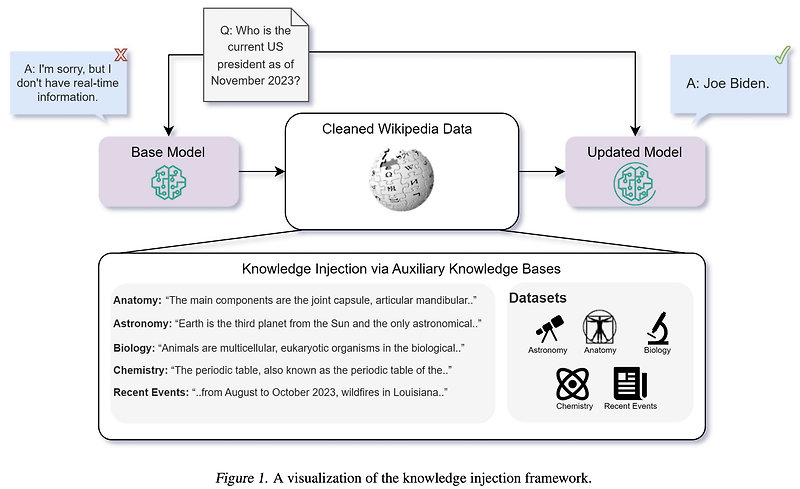

예전(2020.10)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Google Reserach, Brain Team] image patch의 sequence에 pure transformer를 적용하여 image classification을 수행. 타 모델 대비 적은 computational resource를 요하면서도 우월한 성능을 보임. 배경 transformer가 등장하며 NLP를 집어 삼키게 된 이후로, 이 아키텍쳐를 이미지 분야에 적용하고자 하는 여러 시도들이 있었습니다. 각 픽셀을 대상으로 self-attention을 적용하거나 지엽적으로 self-attention을 적용하는 등의 접근이..

원문링크 : <Image> [ViT] An Image is Worth 16x16 Words: Transformers for Image Recognition at Scale

![<Retrieval> [DSI] Transformer Memory as a Differentiable Search Index (2022.02) <Retrieval> [DSI] Transformer Memory as a Differentiable Search Index (2022.02)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbwxZjL%2FbtsAs7vzXIv%2FcZzO6B9p9MmLeQSeuhjwuk%2Fimg.png)

![<LK Lab, Evaluation> [FLASK] Fine-Grained Language Model Evaluation Based on Alignment Skill Sets (2023.10) <LK Lab, Evaluation> [FLASK] Fine-Grained Language Model Evaluation Based on Alignment Skill Sets (2023.10)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbKdcxs%2FbtsAiEnz05y%2FiAoAXwxSEZuanyHCbtjGuk%2Fimg.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티