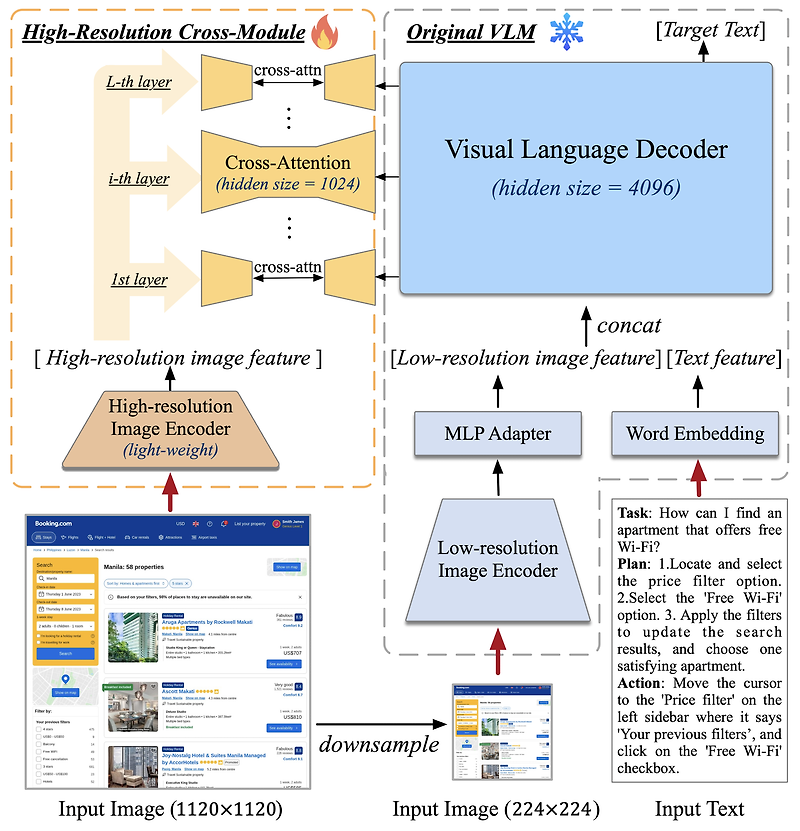

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Tsinghua University, Zhipu AI] - GUI에 대한 이해가 뛰어난 18B 사이즈의 Visual Language Model (VLM)을 도입 - low-resolution & high-resolution image encoder를 동시에 사용하고 cross attention - VQA & GUI 벤치마크 둘 다에서 뛰어난 성능이 확인됨 1. Introduction 최근 LLM을 바탕으로 한 agent의 성장세가 가파른 상황입니다. 무려 15만 개의 star를 받은 AutoGPT를 시작으로 LLM의 능력을 다양한 applica..

원문링크 : <Agent, VLM> CogAgent: A Visual Language Model for GUI Agents (2023.12)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티