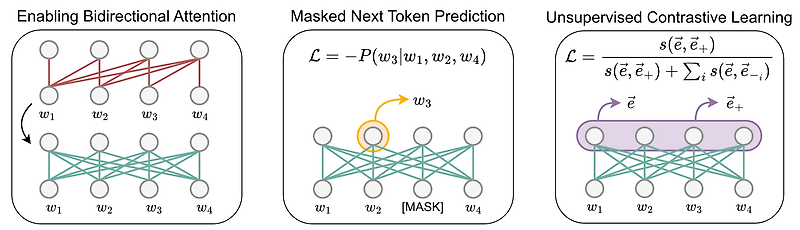

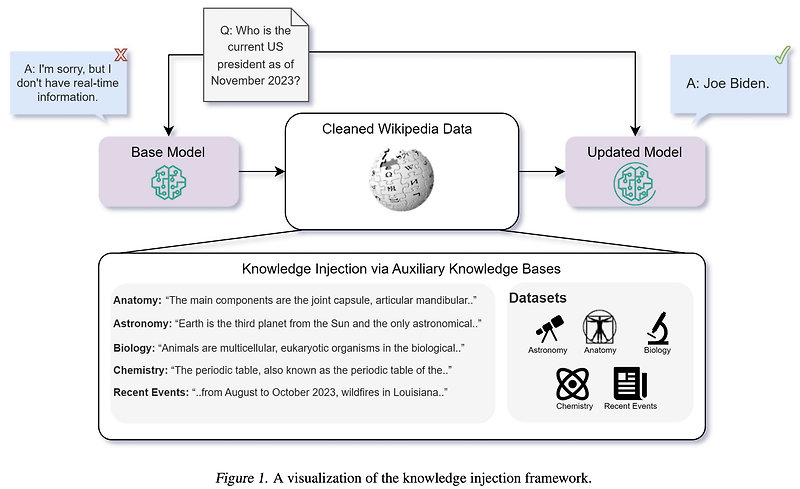

관심 있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ usechatgpt init success [Mila, McGill University, Facebook CIFAR AI Chair] - decoder-only LLM을 강력한 텍스트 encoder로 변환해주는 간단한 unsupervised approach, LLM2Vec - 1) enabling bidirectional attention 2) masked next token prediction 3) unsupervised contrastive learning, 세 개의 요소로 구성 - publicly available 데이터만 이용하여 모델을 학습 - supervised contras..

원문링크 : <Embedding> LLM2Vec: Large Language Models Are Secretly Powerful Text Encoders (2024.04)

![[BOJ] 9019 : DSLR [DFS/BFS](Python) [BOJ] 9019 : DSLR [DFS/BFS](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티