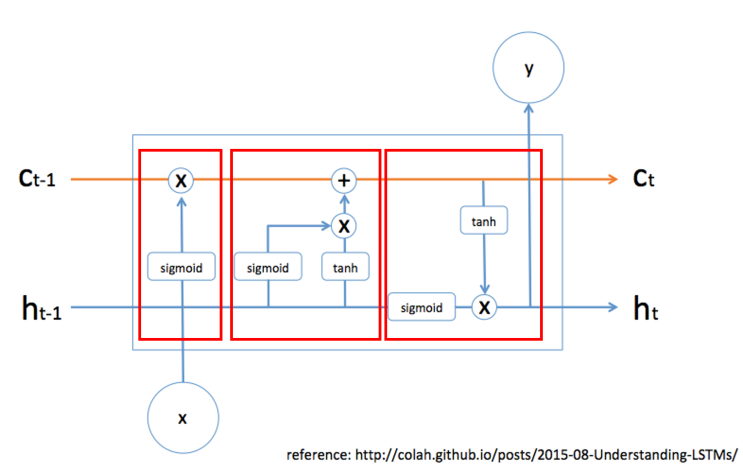

저번 포스팅에서는 RNN 모델에 대해서 알아보았습니다. 이번에는 RNN 모델의 장기 의존성 문제(RNN 시점(문장)이 길어질수록 정보가 뒤로 충분히 전달 되지 못하는 문제)를 해결하기 위해 메모리 셀을 추가한 LSTM 모델에 대해서 정리해보겠습니다. ** 본 포스팅은 PC에 최적화 되어있으며, tensorflow 버전은 2.9.1, 작업환경은 colab입니다. ** **공부 참고 자료 - 허민석, 『나의 첫 머신러닝/ 딥러닝』, 위키북스, 2020. ** LSTM 모델 구조 http://colah.github.io/posts/2015-08-Understanding-LSTMs/ 실습 전에 LSTM 모델 구조를 간단하게 알아보겠습니다. RNN 모델과 달리 LSTM 모델에는 메모리셀이 있습니다. 첫번째 그림을 보면 크게 3가지 파트로 계산이 이루어지고 있는 것을 알 수 있는데요. 각 파트의 역할은 아래와 같습니다. 첫번째 파트 : 메모리셀의 기본 정보를 어느정도 기억할 것인지 sigmoi...

#lstm

#NLP

#tensorflow

#딥러닝

원문링크 : Tensorflow LSTM 구조 및 예제 - 지문읽고 주제 분류하기 / NLP 전처리 맛보기

![[Python] 백준 실버4 1049번 기타줄 (그리디)](https://mblogthumb-phinf.pstatic.net/MjAyNDAyMTJfMTU5/MDAxNzA3NzM4OTAxMTUw.CGKCnhayC0OsuUNhxq0JHz4pcNXTR_23PbeCq8k6m90g.V4tPF8dEX6KU3DECFmCppzcl8e60n2daMi5h9BbwWocg.PNG.dbwjd516/image.png?type=w2)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티