![<Retrieval> [RAG] Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks (2021.04) <Retrieval> [RAG] Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks (2021.04)](http://img1.daumcdn.net/thumb/R800x0/?scode=mtistory2&fname=https%3A%2F%2Fblog.kakaocdn.net%2Fdn%2FbS4ww9%2FbtsAbosxR5p%2FkXifNSEhkT4VVSwztMzTlk%2Fimg.png)

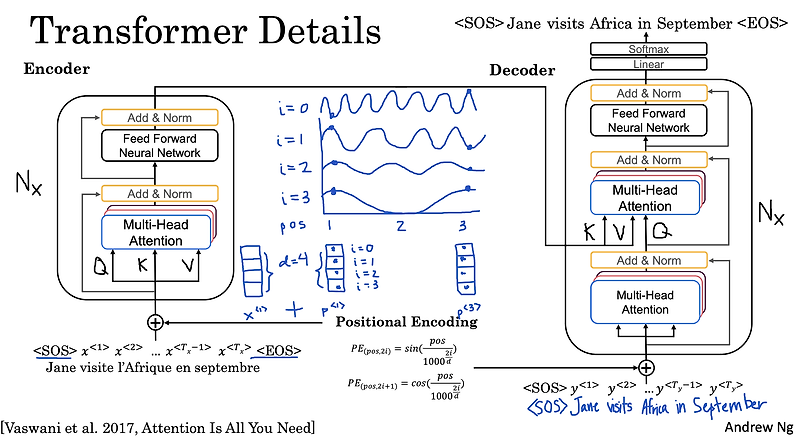

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다. (Language & Knowledge Lab의 Retreival 관련) 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 ️ [RAG] Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks (2021.04) [Facebook AI Research] - parametric memory는 사전학습된 seq2seq, non-parametric momory는 위키피디아의 dense vector index - 하나의 retrieved passage로 sequence 전체를 생성하는 방식 vs 각 토큰별로 다른 retrieved passage를 참고하는 방식 배경 사전학습된 Neural..

원문링크 : <Retrieval> [RAG] Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks (2021.04)

![[BOJ] 9019 : DSLR [DFS/BFS](Python) [BOJ] 9019 : DSLR [DFS/BFS](Python)](http://t1.daumcdn.net/tistory_admin/static/images/openGraph/opengraph.png)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티