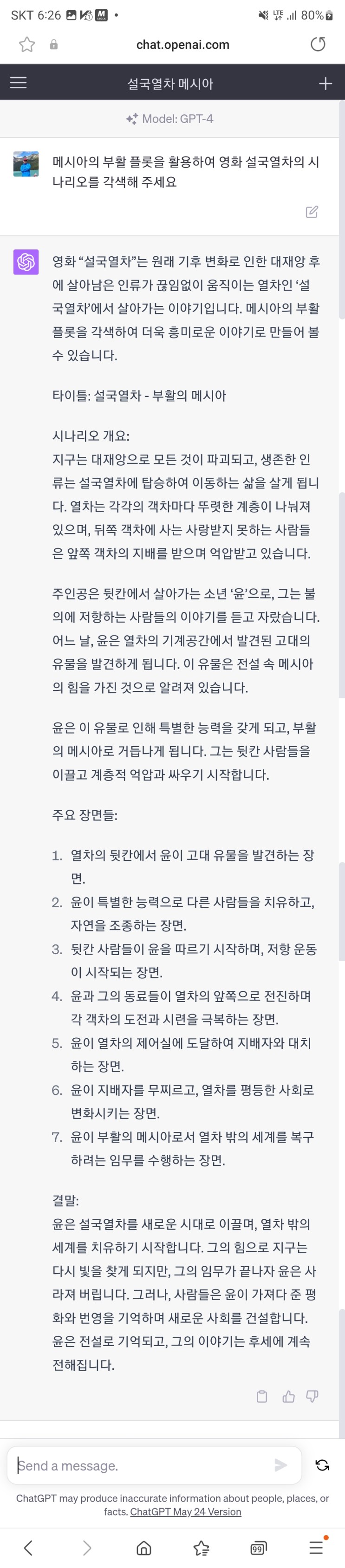

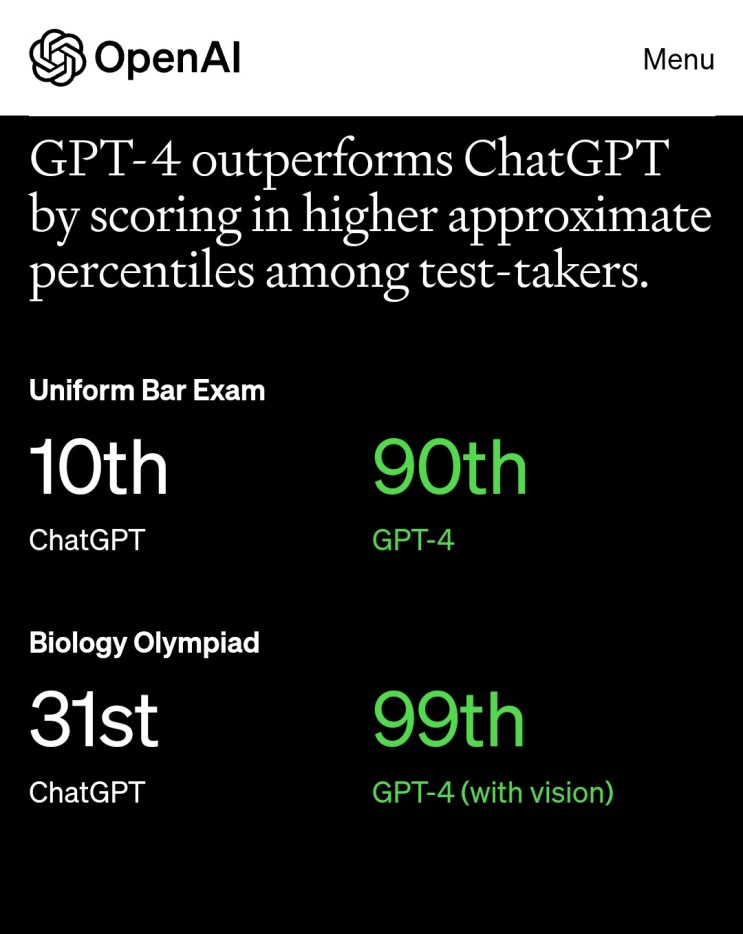

안녕하세요. 챗GPT의 바다를 순항 중인 컬럼B 입니다. 챗GPT가 우수한 성능을 보이는 이유를 살펴보다 보니 "트랜스포머"(Transformer)라는 녀석이 자주 등장합니다. 그래서 그 궁금증을 해결하기 위해 오늘은 아래의 주제를 들여다 보기로 했습니다. 역시 이 주제 역시 우리의 해결사 챗GPT에게 질문을 해봤습니다. Transformer가 특히 효과적인 딥러닝 아키텍쳐인 이유가 뭔지 알려줘 Transformer 아키텍처가 특히 효과적인 딥러닝 아키텍처인 이유는 여러 가지입니다: 1. **병렬 처리**: Transformer는 시퀀스 데이터를 처리할 때, 전체 시퀀스를 한 번에 처리합니다. 이는 RNN(Recurrent Neural Network)과 같은 순차적인 모델과 대조적입니다. RNN은 시퀀스를 순차적으로 처리하기 때문에 병렬화가 어렵지만, Transformer는 입력 시퀀스의 모든 요소를 동시에 처리하여 학습 속도가 빠릅니다. 2. **Attention 메커니즘**: T...

#NLP

#ScaleDotproductattention

#Self

#SelfAttention

#Transformer

#병렬처리

#챗GPT

#트랜스포머

#트랜스포머강력한이유

원문링크 : 트랜스포머가 강력한 이유 5가지 (feat 챗GPT)

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티