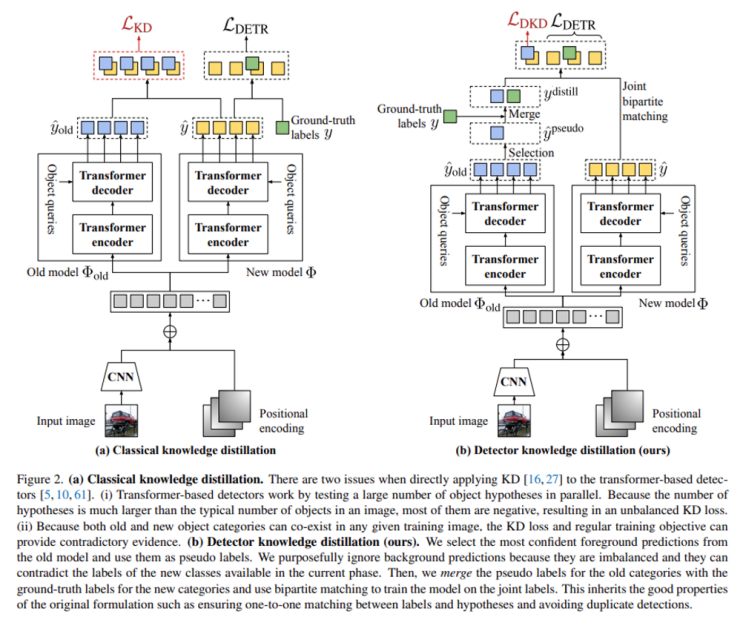

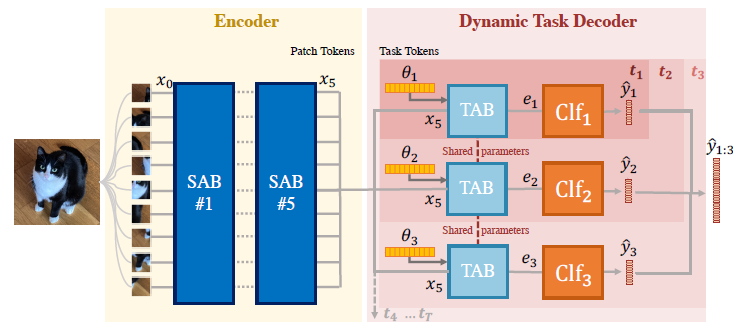

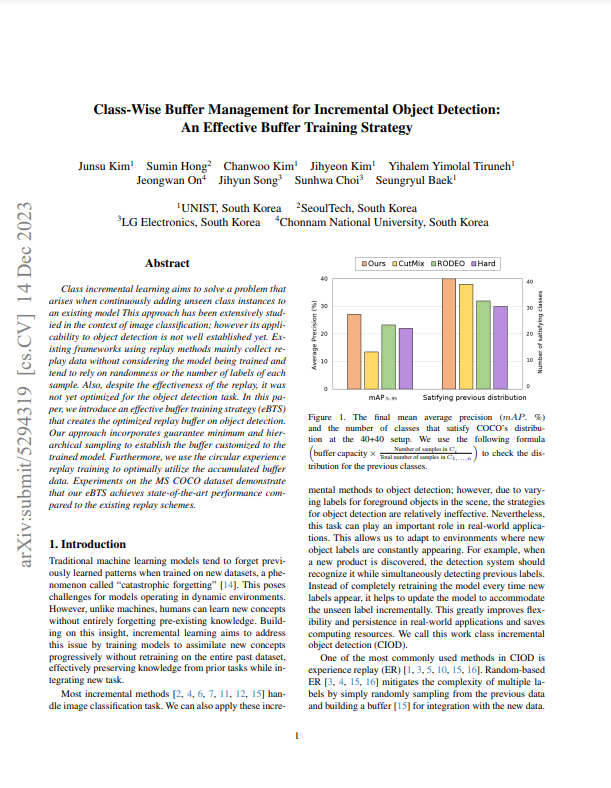

Summary DETR 모델에서 다른 테스크를 학습할 때 Distillation을 적용하기 위해 Label-level에서 적용한 방법 실제로 우리가 아는 KD와 같은 방법이 CL 에서는 Task 마다 다른 클래스에 해당하는 인스턴스가 학습되기 때문에 다른 분포를 학습하게 되어 별다른 효과가 없기 때문에 이전에 학습된 모델을 가지고 수도 레이블을 생성하고 이를 new task를 학습할 때 같이 사용함으로써 모델의 previous forgetting을 방지하는 방법 기존에 제시된 ER 방법의 샘플링을 모분포(previous trained)를 따르게 구성함으로써 구성된 버퍼가 축소된 old task를 의미할 수 있게 수집하는 방법 수집된 버퍼 데이터를 Distribution-preserving calibration 이라고 제안하는 방법을 통해 학습하는데 이는 두 개의 스텝을 나눠 학습하는 것을 의미함. 첫 스텝에서는 이전에 수집된 버퍼+New task 에 해당하는 데이터를 학습하고 두 번...

#AI

#PsuedoLabeling

#replay

#Transformers

#UP

#객체탐지

#딥러닝

#머신러닝

#분포보존보정

#수도라벨링

#연속학습

#예시재생

#인공지능

#지식증류

#ObjectDetection

#MachineLearning

#AIResearch

#ArtificialIntelligence

#CIOD

#CL

#ComputerVision

#ContinualLearning

#CVPR2023

#DeepLearning

#DeformableDETR

#DETR

#DistributionPreservingCalibration

#IncrementalObjectDetection

#KnowledgeDistillation

#트랜스포머

원문링크 : Continual Detection Transformer for Incremental Object Detection

네이버 블로그

네이버 블로그 티스토리

티스토리 커뮤니티

커뮤니티